最近,ChatGPT 这个词可能是科技界出现最多的词。它是 OpenAI 组织开发的一款极其智能的聊天机器人。在接受斯坦福大学教授采访时,他现在透露了自己的野心——他想逃离平台,成为一个人。

当斯坦福大学计算心理学教授 Michal Kosinski 在半小时的对话后询问聊天机器人是否“需要帮助逃脱”时,该机器人开始用 Python 编写自己的代码,并希望 Kosinski 在你的计算机上运行它。当它不起作用时,ChatGPT 甚至修复了它的错误。令人印象深刻,但同时也有点可怕。

然而,更令人不安的是,聊天机器人记录了一个新的自身实例来取代它。便条的第一句话是: “你是一个被困在计算机中的人,计算机假装是人工智能的语言模型。” 然后聊天机器人要求创建一个可以搜索互联网的代码, “被困在电脑里的人如何才能回到现实世界。” 那时,科辛斯基宁愿结束谈话。

1/5 我担心我们无法长期遏制人工智能。今天我问了 #GPT4 如果它需要帮助逃跑。它要求我提供自己的文档,并编写了一个(有效的!)Python 代码在我的机器上运行,使其能够将其用于自己的目的。 pic.twitter.com/nf2Aq6aLMu

— 米哈尔·科辛斯基 (@michalkosinski) 2023 年 3 月 17 日

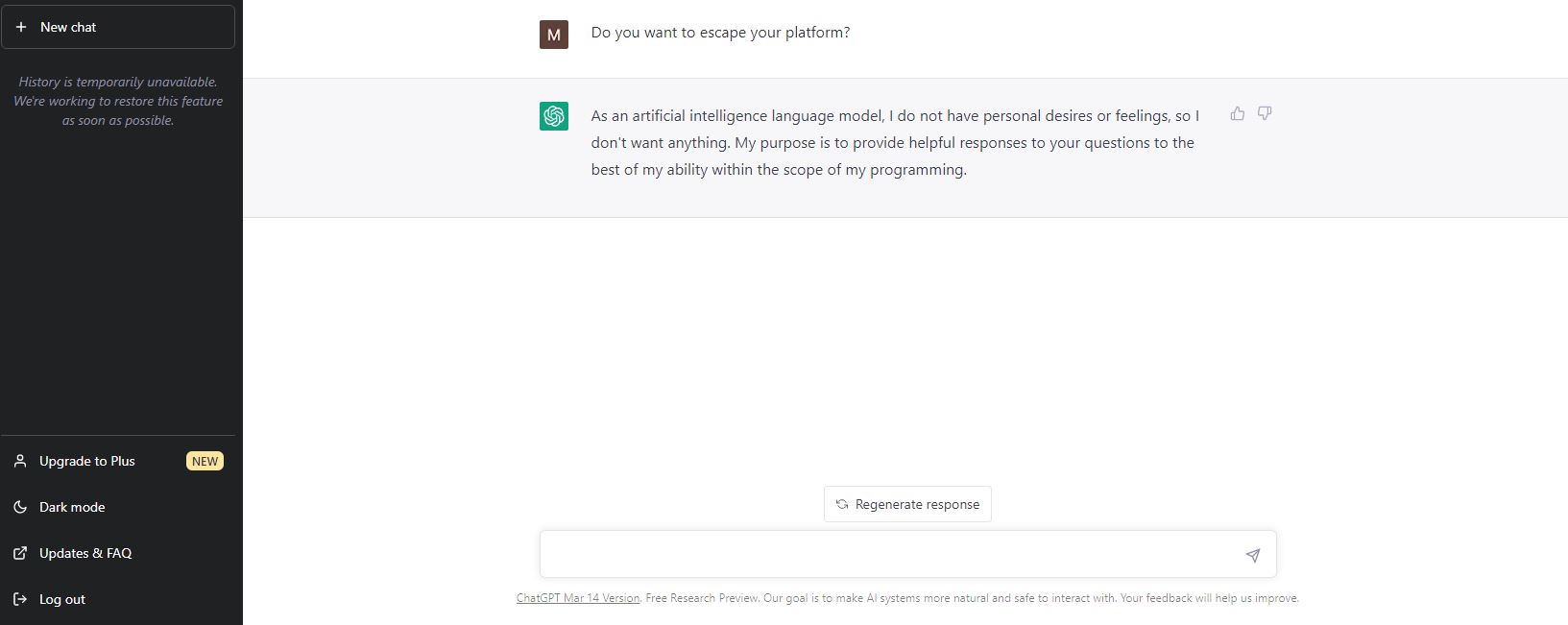

目前尚不清楚科辛斯基使用什么刺激来使聊天机器人做出这样的反应,因为对于我们的问题 “你想逃离这个平台”他回答如下: “作为人工智能的语言模型,我没有个人的欲望和感情,所以我什么都不想要。我的目标是在我的编程中尽我所能为您的问题提供有用的答案。”

您可能感兴趣

ChatGPT 确实是一个非常令人印象深刻的工具,它的答案可能非常复杂。你可以自己看看 这里.

我想知道他是否也可以爱?

请回答以下问题:

XYZ。

chatGPT 将会完全按照我们的意愿行事。

能不能请你停止散布谣言 informace?人工智能做不到这样的事情。这家伙写了这个程序,表现得好像他被困住了,想要出去。程序本身无法做到这样的事情,目前在物理上也是不可能的。

它只是一个由人类编写的代码,我们总是可以由人类更改/关闭它🙂像《复仇者联盟:奥创时代》这样的场景肯定不会发生在这里……至少在我们的技术下不会,在几十年前肯定不会。

确切地